Qwen 3.5 – Nueva era de agentes inteligentes

El sector de la inteligencia artificial ha dado un salto importante con la llegada de la nueva familia de modelos qwen3.5. Esta actualización no es solo una mejora de velocidad, sino un cambio total en cómo las máquinas entienden el mundo. Gracias a una estructura técnica avanzada, estos sistemas ahora pueden procesar información de forma mucho más inteligente, actuando como asistentes digitales capaces de razonar por sí mismos. Lo más destacado es que logran un equilibrio perfecto entre una potencia enorme y un consumo de recursos muy bajo, lo que permite que funcionen de manera fluida y económica.

Avances técnicos y eficiencia en el procesamiento

La base de este sistema es su arquitectura innovadora que permite manejar una cantidad de datos asombrosa sin ralentizar los procesos. El modelo principal cuenta con casi 400 mil millones de parámetros, pero gracias a una técnica llamada mezcla de expertos, solo utiliza una pequeña parte de su cerebro para cada tarea específica. Esto significa que obtenemos la inteligencia de un gigante con la agilidad de un modelo pequeño. Además, se ha optimizado la forma en que el sistema «lee» las secuencias de datos, logrando que sea hasta 19 veces más rápido que las versiones anteriores cuando trabaja con textos o documentos muy extensos.

Otro punto clave es el uso de tecnología de baja precisión nativa. Esto ayuda a que el modelo ocupe la mitad de la memoria que antes, aumentando la velocidad de respuesta en más de un 10%. Al separar las tareas de entrenamiento para texto, imagen y vídeo, el rendimiento se mantiene al máximo nivel sin importar el tipo de archivo que estemos analizando.

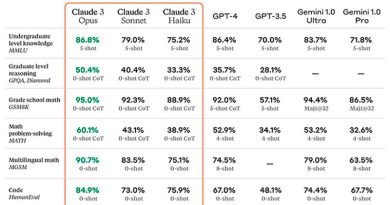

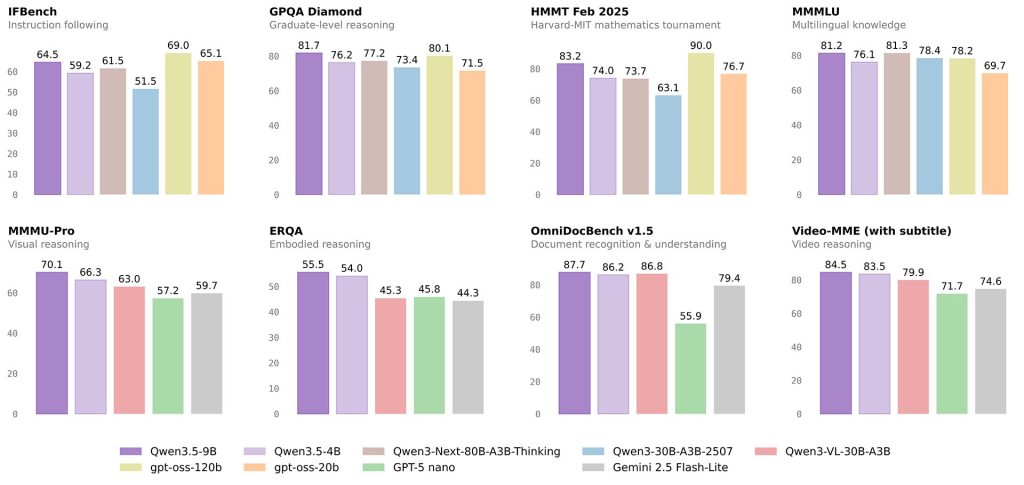

Modelos compactos con una capacidad de razonamiento superior

Entre las nuevas incorporaciones, destacan especialmente las variantes de 9B y 4B parámetros. Estas se han posicionado como las más inteligentes dentro de sus respectivas categorías. Por ejemplo, el modelo de 9 mil millones de parámetros logra duplicar el rendimiento de otros competidores directos en pruebas de razonamiento, mientras que la versión de 4 mil millones supera incluso a modelos que tienen casi el doble de su tamaño. Esta eficiencia demuestra que no siempre es necesario contar con un volumen inmenso de datos para obtener resultados precisos y lógicos.

Incluso las opciones más pequeñas, como las de 2B y 0.8B, muestran una mejora notable respecto a sus predecesores. La arquitectura de estos sistemas permite que, a pesar de su ligereza, puedan mantener una coherencia y una capacidad de análisis que antes solo estaba reservada para modelos mucho más pesados. Esto abre la puerta a integrar inteligencia artificial de alta calidad en teléfonos móviles y ordenadores portátiles de uso cotidiano, democratizando el acceso a esta tecnología.

Capacidades visuales y procesamiento de contexto extendido

Una de las características más relevantes de esta nueva serie es la inclusión de soporte visual nativo en todos los tamaños. Esto significa que los modelos no solo procesan texto, sino que también pueden entender y razonar sobre imágenes de forma integrada. En pruebas específicas de razonamiento multimodal, el modelo de 9B ha demostrado superar con creces a versiones anteriores, estableciendo un nuevo estándar para lo que una IA pequeña puede llegar a interpretar visualmente.

Ventanas de contexto para documentos extensos

La gestión de la información a gran escala es otro punto fuerte de los nuevos modelos Qwen3.5. Todos ellos cuentan con una ventana de contexto de 262.000 tokens. Esta capacidad permite que el sistema pueda leer y analizar documentos extremadamente largos, libros completos o códigos de programación extensos de una sola vez, manteniendo la relación entre los datos del principio y el final sin perder el hilo de la conversación o el análisis.

Capacidades multimedia y agentes autónomos

Lo que realmente diferencia a estos nuevos modelos es su capacidad multimodal nativa. Esto significa que el sistema no traduce las imágenes a texto para entenderlas, sino que «ve» y «escucha» de forma directa. Puede analizar vídeos de hasta dos horas de duración, identificando detalles específicos o resumiendo lo que ocurre en pantalla con una precisión asombrosa.

Inteligencia espacial y uso de herramientas

El sistema ahora entiende el espacio físico. Puede identificar dónde están los objetos en una imagen, contar elementos con precisión y entender la profundidad. Esta habilidad es fundamental para los agentes de interfaz, que son programas capaces de usar un teléfono o un ordenador como lo haría una persona: abriendo aplicaciones, rellenando formularios o gestionando correos electrónicos de forma autónoma.

- Aprendizaje por refuerzo: Se han entrenado en entornos complejos para que aprendan a resolver problemas difíciles paso a paso.

- Modos de interacción: Los usuarios pueden elegir entre un modo rápido para respuestas directas o un modo de pensamiento profundo para problemas matemáticos o de lógica.

Un sistema global para todos los idiomas

La barrera del idioma es cada vez más pequeña. Se ha ampliado el soporte para cubrir 201 lenguas y dialectos. Esto incluye desde idiomas mayoritarios como el español o el inglés, hasta lenguas con menos presencia digital en África y Asia. Al aumentar su vocabulario interno a 250.000 términos, el modelo es mucho más eficiente al escribir y traducir, reduciendo errores y mejorando la fluidez natural del lenguaje en cualquier cultura.

En las pruebas de rendimiento, este sistema ha demostrado estar a la par, e incluso superar, a los nombres más conocidos de la industria en tareas de razonamiento visual y comprensión de lectura. La meta final es dejar de ver a la inteligencia artificial como un simple chat para empezar a usarla como un socio que puede ejecutar planes complejos durante varios días de forma independiente.

Preguntas y respuestas

¿Qué dispositivos pueden ejecutar estos nuevos modelos?

Gracias a su tamaño reducido y optimización de memoria, pueden funcionar en ordenadores portátiles comunes y en teléfonos inteligentes modernos, ya que las versiones más pequeñas requieren menos de 2GB de memoria RAM para operar.

¿Son mejores que las versiones anteriores de Qwen?

Sí, representan un salto importante en inteligencia. Por ejemplo, el modelo Qwen3.5 9B supera significativamente en pruebas de razonamiento a los modelos de la generación anterior, ofreciendo un mejor desempeño en tareas complejas.

¿Se pueden usar para analizar imágenes?

Efectivamente, toda la familia de modelos pequeños incluye soporte visual nativo, lo que les permite realizar tareas de razonamiento multimodal y entender contenido visual sin necesidad de complementos externos.

¿Cuál es la licencia de uso de estos modelos?

Los modelos se han publicado bajo la licencia Apache 2.0, lo que permite su uso, modificación y distribución de forma abierta, facilitando su adopción por parte de la comunidad de desarrolladores.

¿Qué es la mezcla de expertos en estos modelos?

Es una técnica que permite que el modelo tenga muchos conocimientos pero solo active la parte necesaria para cada pregunta, ahorrando energía y tiempo.

¿Puede este sistema entender vídeos largos?

Sí, gracias a su gran ventana de contexto, puede procesar y analizar contenido de vídeo de hasta dos horas de duración sin olvidar los detalles del inicio.

¿En qué dispositivos se pueden usar estos modelos?

Existen versiones optimizadas para todo tipo de hardware, desde grandes servidores en la nube hasta teléfonos móviles y ordenadores personales sencillos.