Midjourney Video V1: El Salto al Movimiento

Midjourney, un referente en la creación de imágenes mediante inteligencia artificial, ha dado un salto significativo con la introducción de su modelo Video V1. Este lanzamiento marca un hito crucial, no como un producto final, sino como el primer eslabón en una ambiciosa cadena de desarrollo. La visión a largo plazo de la compañía es construir «simulaciones de mundo abierto en tiempo real» y una «infraestructura sensorial para mundos generados por IA». David Holz, CEO de Midjourney, ha expresado el objetivo de un sistema de IA capaz de generar imágenes en tiempo real, permitiendo la interacción y el movimiento tanto de los entornos como de los personajes en un espacio tridimensional.

El modelo V1 se posiciona estratégicamente como el pilar de «movimiento» en esta hoja de ruta, anticipando futuras capacidades de modelado 3D y funcionalidades en tiempo real. Esta particularidad lo diferencia de sus competidores directos, como OpenAI Sora, Runway Gen-3/Gen-4 y Google Veo, que suelen enfocarse en la generación de video a partir de texto. Midjourney prioriza la velocidad de generación y la consistencia temporal, aspectos vitales para su meta de simulación de mundos, por encima de una resolución ultra-alta en esta fase inicial.

Funcionalidades y Uso de Midjourney Video V1

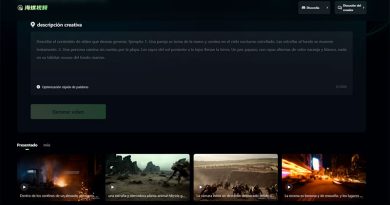

Midjourney Video V1 se especializa en la función de «Imagen a Video» (I2V), lo que permite transformar imágenes estáticas en clips animados. Este enfoque facilita a los usuarios la animación de imágenes previamente creadas en Midjourney (especialmente con la versión V7) o la carga de imágenes externas. El sistema genera cuatro variaciones de videoclips, cada uno con una duración aproximada de 5 segundos.

Opciones de Extensión y Control de Movimiento

Los videoclips generados pueden extenderse en segmentos de 4 segundos, alcanzando una duración máxima total de aproximadamente 21 segundos. Para ello, Midjourney ofrece dos modalidades de extensión: «Extensión automática», que utiliza el prompt original, y «Extensión manual», la cual brinda la flexibilidad de modificar el prompt para variar la secuencia.

El control del movimiento en los videos se ofrece a través de varias opciones. En el modo «Automático», el sistema de inteligencia artificial se encarga de crear un «prompt de movimiento», generando animaciones de forma autónoma. El modo «Manual», por otro lado, otorga al usuario la libertad de describir con precisión cómo desea que los elementos se muevan y cómo se desarrolle la escena. Para escenas con movimientos sutiles o donde la cámara permanece relativamente estática, la opción «Low Motion» es ideal. En contraste, «High Motion» es más adecuada para escenas con movimientos dinámicos de cámara y sujetos, aunque Midjourney advierte que esta modalidad podría generar «errores extraños» en las fases iniciales.

Guía para Prompts de Movimiento Eficaces

Cuando se trabaja en el modo manual, es crucial que los prompts de movimiento contengan «verbos de acción», «conexiones temporales» y una clara «progresión de escena». Estos elementos son fundamentales para guiar a la IA en la construcción de una mini-historia coherente. Es recomendable evitar la inclusión de terminología fotográfica que no sea relevante, como «8K» o «HDR», ya que podría interferir con la interpretación del movimiento. Por ahora, el acceso a Midjourney Video V1 está limitado a la interfaz web de Midjourney.com, no siendo accesible a través del bot de Discord.

Costos y Accesibilidad del Servicio

Midjourney Video V1 está incluido en todos los planes de suscripción de pago, con precios que inician desde los 10 dólares al mes. Cada trabajo de video consume aproximadamente ocho veces los minutos de GPU que un trabajo de imagen, lo que significa que el costo de generar un video es comparable al de un proceso de «upscale» o al valor de «un segundo de video por cada imagen». Midjourney asegura que su modelo es significativamente más económico que otras opciones disponibles en el mercado, estimando que es «más de 25 veces más barato». Además, se está probando un «modo relax de video» para los suscriptores de planes «Pro» y superiores, lo que permitirá la generación de videos con menor prioridad, pero a un costo reducido y sin límites de duración.

Puntos Fuertes y Desafíos de Video V1

Ventajas Destacadas

Una de las principales fortalezas de Midjourney Video V1 es su notable consistencia estilística, manteniendo la estética, las pinceladas y la atmósfera de la imagen original a lo largo de todo el video y sus extensiones. La generación rápida es otra ventaja clave, ya que es capaz de producir cuatro videos en aproximadamente 65 segundos, optimizando así la eficiencia del proceso creativo. Las extensiones estables aseguran que los videos mantengan una fluidez visual, incluso cuando se prolongan. Además, su accesibilidad y facilidad de uso lo convierten en una herramienta atractiva para un amplio público. La calidad estética, especialmente en la composición y el color, sigue los altos estándares visuales por los que Midjourney es reconocido.

Limitaciones Actuales

A pesar de sus puntos fuertes, Video V1 presenta algunas limitaciones iniciales. La resolución está actualmente restringida a 480p y carece de un escalador incorporado, lo que lo hace «no apto para uso profesional o producción de alta calidad». Midjourney ha prometido un escalador de video para futuras actualizaciones. Otra limitación importante es que solo soporta la función Imagen a Video (I2V), lo que significa que no permite la generación de video a partir de texto («text-to-video»), a diferencia de muchos de sus competidores. En las primeras etapas, pueden surgir artefactos de movimiento, como «errores extraños» o «artefactos» en extremidades o fondos que se transforman de forma antinatural, especialmente con el ajuste «high motion». También se ha observado que los videos pueden sentirse repetitivos o cíclicos, careciendo de una coherencia narrativa prolongada. El sistema de prompts de movimiento, aunque funcional, tiene una comprensión limitada de prompts complejos y puede tener dificultades con acciones detalladas o lógica física. Finalmente, los videos generados actualmente carecen de soporte de audio.

Panorama Competitivo y Consideraciones Legales

El lanzamiento de Midjourney Video V1 se produce en un mercado de generación de video por IA que ya cuenta con una fuerte competencia. Entre los principales actores se encuentran OpenAI Sora, enfocado en videos cinematográficos de hasta 60 segundos, Runway Gen-3/Gen-4, que ofrece texto a video con duraciones de 4-8 segundos, y Google Veo, con una capacidad de hasta 60 segundos. Otros competidores incluyen Stability AI (Stable Video Diffusion), Meta (EMU) y Pika. La reputación de Midjourney por su calidad y diseño centrado en el usuario podría darle una ventaja competitiva.

Sin embargo, este lanzamiento se da en un momento de creciente escrutinio legal en torno a la inteligencia artificial. Poco antes del debut de V1, grandes compañías de medios como Disney y Universal presentaron demandas, alegando que Midjourney podría haber utilizado propiedades con derechos de autor (como Homer Simpson o Darth Vader) para entrenar sus modelos. Estas acusaciones han reavivado el debate sobre la transparencia de los datos de entrenamiento y la ética en el desarrollo de la IA. Midjourney ha respondido defendiendo un uso responsable de su tecnología, enfatizando que Video V1 se enfoca en la creatividad personal y no en usos publicitarios o cinematográficos a gran escala.

La Visión a Futuro de Midjourney Video

El modelo V1 es solo un punto de partida en la visión a largo plazo de Midjourney. Los planes futuros son ambiciosos e incluyen la generación en tiempo real, la animación 3D y el modelado espacial, y la personalización de la trayectoria de la cámara. La integración de audio y diálogo también figura entre sus próximos objetivos. Esta hoja de ruta posiciona a Midjourney para evolucionar hacia una «suite creativa completa», capaz de funcionar como una «cadena de producción para escenas animadas enteras, tráilers conceptuales y generación de contenido en tiempo real». Para Midjourney, V1 no es el final del camino, sino una «puerta hacia la imaginación» y, potencialmente, la «primera puerta hacia el metaverso».

Preguntas y Respuestas

¿Qué es Midjourney Video V1?

Midjourney Video V1 es el primer modelo de generación de video de Midjourney, centrado en transformar imágenes estáticas en clips animados (Imagen a Video) y es un «trampolín» hacia la visión de la compañía de «simulaciones de mundo abierto en tiempo real».

¿Cómo se diferencia Midjourney Video V1 de otros generadores de video por IA?

A diferencia de competidores como OpenAI Sora o Google Veo, Midjourney Video V1 se enfoca en la funcionalidad de Imagen a Video (I2V) y prioriza la velocidad de generación y la consistencia temporal, elementos cruciales para su objetivo de simulación de mundos en tiempo real, más que la resolución ultra-alta o la generación de video a partir de texto.

¿Cuáles son las principales limitaciones de Midjourney Video V1 actualmente?

Las principales limitaciones incluyen una resolución máxima de 480p sin escalador incorporado, soporte exclusivo para Imagen a Video (no Texto a Video), posibles artefactos de movimiento en escenas dinámicas, videos que pueden sentirse cíclicos o carecer de coherencia narrativa compleja, una comprensión limitada de prompts de movimiento muy elaborados y la ausencia de soporte de audio.

¿Cuál es la visión a futuro de Midjourney para su tecnología de video?

La visión a futuro de Midjourney es expandir Video V1 hacia la generación en tiempo real, animación 3D y modelado espacial, personalización de la trayectoria de la cámara, e integración de audio y diálogo. El objetivo es convertirse en una «suite creativa completa» para la producción de escenas animadas y contenido en tiempo real, sirviendo como una «primera puerta hacia el metaverso».